不客气的说,大多数AI芯片都得死

商业技术评论按:作为AI和芯片两大领域的交叉点,AI芯片已经成了最热门的投资领域,各种AI芯片如雨后春笋般冒出来,但是AI芯片领域生存环境恶劣,能活下来的企业将是凤毛麟角,以下正文:

不久前,谷歌在I/O大会发布了其第三代TPU,并宣称其性能比去年的TUP 2.0提升8倍之多,达到每秒1000万亿次浮点计算,同时谷歌展示了其一系列基于TPU的AI应用。

可以说,AI已经成为科技行业除了区块链之外最热门的话题。AI芯片作为AI时代的基础设施,也成为目前行业最热门的领域。

可以看到,AI芯片已经成为资本追逐的最热门领域,资本对半导体芯片的热情被AI技术彻底点燃。在创业公司未真正打开市场的情况下,AI芯片初创企业已经诞生了不少的独角兽,多笔融资已经超过亿元。

AI技术的革新,其从计算构架到应用,都和传统处理器与算法有巨大的差异,这给创业者和资本市场无限的遐想空间,这也是为什么资本和人才对其趋之若鹜的原因。

但是,产业发展还是要遵循一定的产业规律,「商业技术评论」认为,绝大多数AI芯片公司都将成为历史的炮灰,最后,在云端和终端只剩下为数极少的几个玩家。

为何这么说,请听本社慢慢道来!

首先我们来分析下目前对AI芯片的需求主要集中在哪些方面。

先来讲讲AI目前芯片大致的分类:从应用场景角度看,AI芯片主要有两个方向,一个是在数据中心部署的云端,一个是在消费者终端部署的终端。从功能角度看,AI芯片主要做两个事情,一是Training(训练),二是Inference(推理)。

目前AI芯片的大规模应用主要还是在云端。云端的AI芯片同时做两个事情:Training和Inference。Training即用大量标记过的数据来“训练”相应的系统,使之可以适应特定的功能,比如给系统海量的“猫”的图片,并告诉系统这个就是“猫”,之后系统就“知道”什么是猫了;Inference即用训练好的系统来完成任务,接上面的例子,就是你将一张图给之前训练过的系统,让他得出这张图是不是猫这样的结论。

Training和Inference在目前大多数的AI系统中,是相对独立的过程,其对计算能力的要求也不尽相同。

Training需要极高的计算性能,需要较高的精度,需要能处理海量的数据,需要有一定的通用性,以便完成各种各样的学习任务。

Inference相对来说对性能的要求并不高,对精度要求也要更低,在特定的场景下,对通用性要求也低,能完成特定任务即可,但因为Inference的结果直接提供给终端用户,所以更关注用户体验的方面的优化。

Training将在很长一段时间里集中在云端,Inference的完成目前也主要集中在云端,但随着越来越多厂商的努力,很多的应用将逐渐转移到终端。

然后我们来看看目前的市场情况。

1、云端市场已被巨头瓜分殆尽,创业公司生存空间几乎消失。

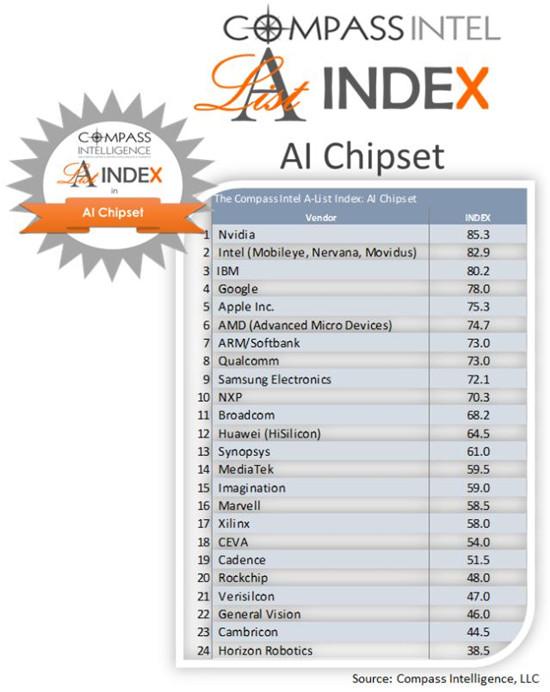

云端AI芯片无论是从硬件还是软件,已经被传统巨头控制,给新公司预留的空间极小。下面这张图是Compass Intelligence公布了全球AI芯片榜单。因为AI芯片目前在终端应用极少,所以榜单头部的排名可以近似的认为就是云端AI芯片的目前市场格局。

我们可以看到,芯片巨头Nvidia(英伟达)已经牢牢占据AI芯片榜首,由于CUDA开发平台的普及,英伟达的GPU是目前应用最广的通用AI硬件计算平台。除了有实力自研芯片的企业(全世界也没几家),如果需要做AI相关的工作,必定需要用到Nvidia的芯片。Nvidia的芯片应用普遍,现在所有的AI软件库都支持使用CUDA加速,包括谷歌的Tensorflow,Facebook的Caffe,亚马逊的MXNet等。

除了一骑绝尘的英伟达,其他老牌的芯片巨头都没闲着,特别是Intel通过买、买、买奋力的将自己挤到了头部玩家的位置。微软在最新的Build大会上公布了基于英特尔FPGA的AI方案,而英特尔的FPGA业务正是通过收购Altera获得的。

除此之外,我们可以看到像Google这样的互联网厂商也乱入了前五。这当然要归功于上面提到的TPU,虽然谷歌不直接售卖芯片,但是谷歌通过云服务提供TPU的调用服务。谷歌很早就开源了Tensorflow软件平台,这使得Tensorflow成为最主流的机器学习软件平台,已经成了事实上行业的软件平台标准。而Tensorflow最佳的计算环境必定就是谷歌自己的云服务了,通过软件、硬件(或者说云)环境的打通,谷歌妥妥的成为AI芯片领域的一方霸主。

现在业界争论的焦点是AI芯片的处理器架构用哪种是最好的,有前面提及的有GPU、FPGA、DSP和ASIC,甚至还有更前沿的脑神经形态芯片。现在GPU可以认为是处于优势地位,但其他几种的处理器架构也各有优势。Intel则是多方下注,不错过任何一种处理器架构。谷歌在TPU(其实就是一种ASIC)方面的巨大投入带来了硬件效能的极大提高,目前看来对GPU的冲击将是最大的,原因不单单是因为专用架构带来的效率优势,还有商业模式方面带来的成本优势。在半导体行业内的普遍观点是,一旦AI的算法相对稳定,ASIC肯定是最主流的芯片形态。看看挖矿芯片的进化历程,这个观点非常有说服力。

在云端,互联网巨头已经成为了事实上的生态主导者,因为云计算本来就是巨头的战场,现在所有开源AI框架也都是这些巨头发布的。在这样一个生态已经固化的环境中,留给创业公司的空间实际已经消失。所以地平线的余凯在前几年就对「商业技术评论」表示,云端市场是巨头的禁脔,创业公司没有任何机会。

2、终端市场群雄割据,机会尚存。

上面说到了Inference现在主要是在云端完成的,这主要是因为现在终端上基本没有合适的处理单元可以完成相应功能。所以我们发现很多AI功能都需要联网才可以使用,这大大限制了AI的使用场景。所以将Inference放到终端来,让一些功能可以本地完成,成了很多芯片厂商关注的领域。

华为的麒麟970便是最早将AI处理单元引入到终端产品的芯片,其中该芯片中的AI核心,是由AI芯片创业公司寒武纪提供的IP(知识产权)。该芯片的引入,可以帮助华为手机在终端完成一些特定的AI应用,比如高效的人脸检测,相片的色彩美化等。此后,苹果,三星都宣布了在其处理器中引入相应的AI处理单元,提升手机终端的AI应用能力。

在终端上,由于目前还没有一统天下的事实标准,芯片厂商可以说是八仙过海各显神通。

给手机处理器开发AI协处理器是目前看来比较靠谱的方式,寒武纪Cambricon-1A集成进入麒麟970就是一个很好的例子。由于华为手机的巨大销量,寒武纪迅速成为AI芯片独角兽。而另外一家创业公司深鉴科技此前获得了三星的投资,其AI芯片IP已经集成到三星最新的处理器Exynos 9810中。

然而能获得手机大厂青睐的AI芯片厂商毕竟是少数,更多的AI芯片厂商还需要找到更多的应用场景来使自己的芯片发光发热。

一些传统AI服务厂商很容易想到将自己的服务进行垂直拓展,比如的自然语音处理厂商云知声从自己的传统语音业务出发,开发了自己的芯片UniOne语音AI芯片,用于物联网IOT设备。

相对于语音市场,安防更是一个AI芯片扎堆的大产业,如果可以将自己的芯片置入摄像头,是一个不错的场景,也是很好的生意。包括云天励飞、海康威视、旷视科技等厂商都在大力开发安防领域的AI嵌入式芯片,而且已经完成了一定的商业化部署。

相对于云端,终端留给AI芯片创业公司更广阔的市场。但是于此同时,由于应用环境千差万别,没有相应的行业标准,各个厂商各自为战,无法形成一个统一的规模化市场,对于投入巨大的芯片行业来说,是好故事,但不一定是个好生意。

最新活动更多

-

3月27日立即报名>> 【工程师系列】汽车电子技术在线大会

-

即日-4.22立即报名>> 【在线会议】汽车腐蚀及防护的多物理场仿真

-

4月23日立即报名>> 【在线会议】研华嵌入式核心优势,以Edge AI驱动机器视觉升级

-

4月25日立即报名>> 【线下论坛】新唐科技2025新品发布会

-

在线会议观看回放>>> AI加速卡中村田的技术创新与趋势探讨

-

即日-5.15立即报名>>> 【在线会议】安森美Hyperlux™ ID系列引领iToF技术革新

分享

分享

发表评论

请输入评论内容...

请输入评论/评论长度6~500个字

暂无评论

暂无评论